| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | 5 | 6 | |

| 7 | 8 | 9 | 10 | 11 | 12 | 13 |

| 14 | 15 | 16 | 17 | 18 | 19 | 20 |

| 21 | 22 | 23 | 24 | 25 | 26 | 27 |

| 28 | 29 | 30 | 31 |

- 데이터 분석

- 분석

- 파이썬

- 빅데이터

- 상관분석

- 활성화함수

- DAGs

- 패스트캠퍼스

- airflow

- API

- Ai

- 머신러닝

- EDA

- 딥러닝

- 직장인자기계발

- 에어플로

- 자동매매프로그램

- 통계분석

- 태국여행

- Python

- 방콕여행

- 데이터

- 독서리뷰

- correlation

- 패스트캠퍼스후기

- 직장인인강

- 패캠챌린지

- 데이터분석

- 파이썬을활용한시계열데이터분석A-Z올인원패키지

- 리뷰

- Today

- Total

데이터를 기반으로

패스트캠퍼스 챌린지 34일차 본문

오늘의 강의는 어제 강의에 이어 정규화 방법론에 대한 이해도 향상과 해당 실습 코드를 돌려보는 시간이었다.

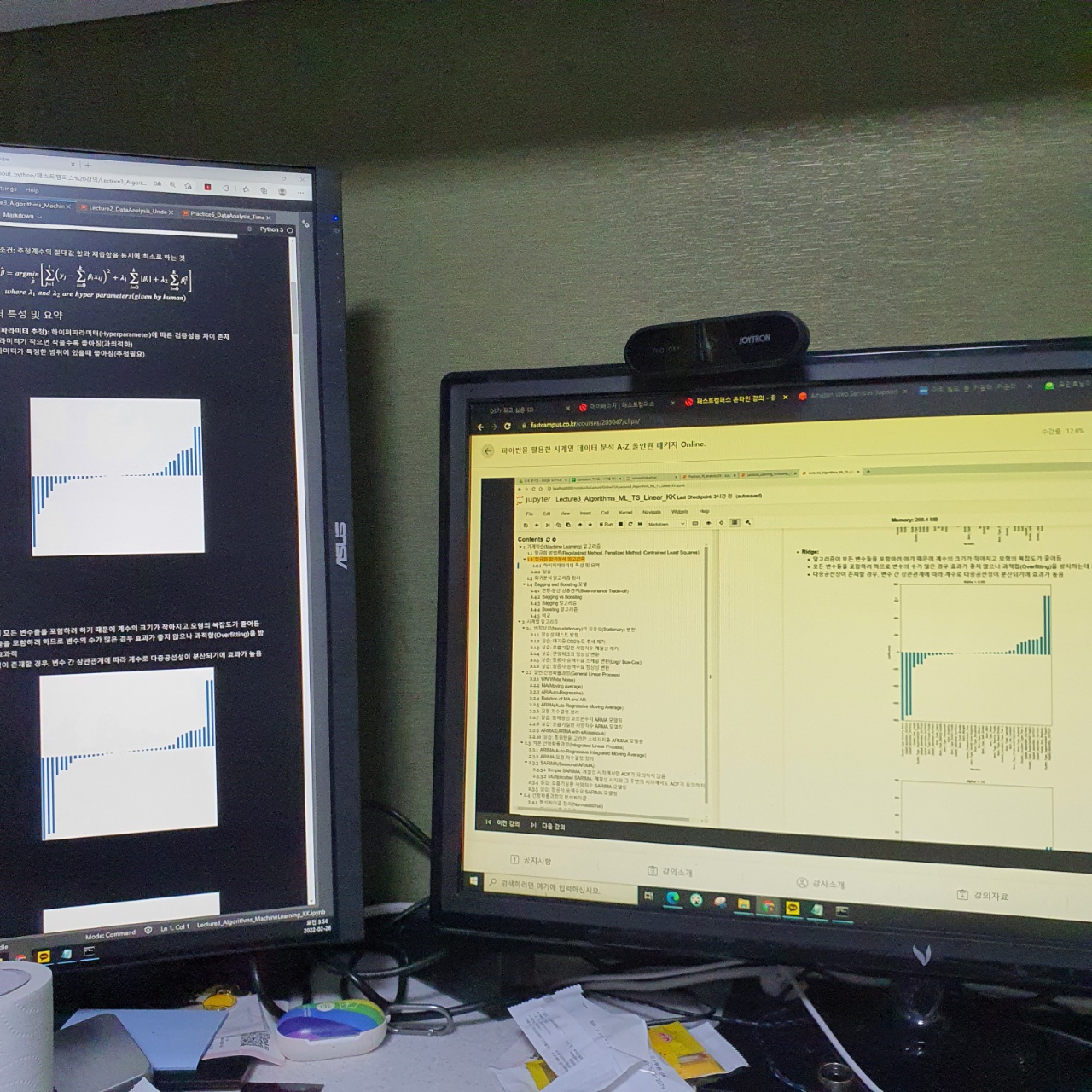

왼쪽 화면은 강의 자료 화면이고 오른쪽 화면은 강의 화면이다.

화면에 보이는 것은 하이퍼파라미터 특성에 대해 파악해보는 부분이다. 해당 화면에 보이는 그래프는 variable coefficients 라고 변수에 대한 상관을 보여지는 그래프 같다.

X축에 각 변수명이 기재되어있고 오른쪽 부터 상관성이 높은 변수부터 왼쪽은 음수로서 상관성이 양의 상관인 변수가 나와있다.

해당 변수들 마다 모델에 미치는 영향도 즉, 계수를 수치화해서 그린 것과 동일한 의미로 보면 될 것 같다. 그렇게 릿지 부분에 대한 그래프를 이어서 보면 알파 값을 줄여주면 줄여줄 수록 계수에 수치가 점점 작아지는 것을 볼 수 있다.

해당 변수에 대한 영향도를 줄여주는 것인데, 중요한 점은 계수의 영향도가 0인 것은 변함이 없고 각 변수의 계수 크기가 상대적으로 줄어든 것을 확인할 수 있다. 이렇게 한 변수에 대해 영향력이 큰 것을 상대적으로 줄여주는 효과를 보여주는 것이 릿지의 효과인데

만약 한 변수의 계수의 값이 크면 해당 변수의 값이 변할 때마다 Y(종속변수)의 값이 크게 달라지기 때문에 적절하지 않다고 보는 것이다.

이러한 현상 자체가 과적합 현상이라고 볼 수 있는데 Train Dataset에 해당 변수의 계수(영향도)가 크게 모델링이 되면 Test Dataset으로 돌려보면 과적합 된 상태로 예측치를 도출하여 테스트 결과가 좋지 않을 것이다. 이러한 릿지의 장점은 과적합을 방지해준다는 것이다.

라쏘는 다중공선성 제거의 탁월한 효과가 있다. 이유는 이전 글에서 설명을 했지만 불필요한 변수를 제거하기 때문이다.

엘라스틱넷은 위 2가지의 장점을 가지고 있는 것이라고 이전 강의시간에 이야기했다. 하지만, 큰 데이터에는 좋은 편이지만 작은 데이터에서 엘라스틱넷은 효과가 떨어진다는 단점을 가지고 있다.

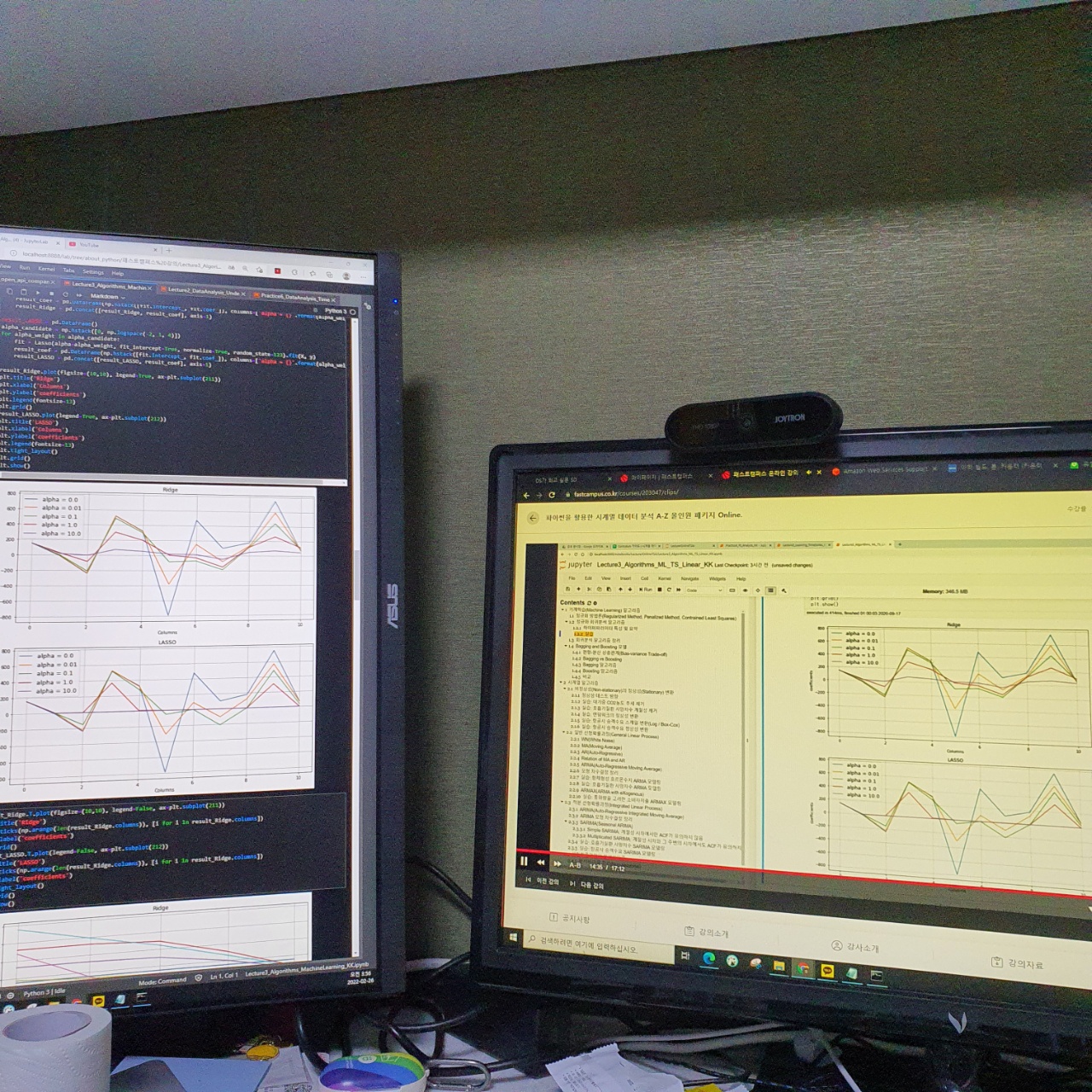

왼쪽 화면은 강의 실습 코드이며 오른쪽 화면은 강의 화면이다.

그림을 보시면 릿지와 라쏘 모델의 알파값이 바뀔때 그래프를 보여준 것인데 알파값이 커질 수록 각 변수들에 대한 스케일이 작아지는 것을 확인할 수 있다.

그리고 다음 그래프는 비슷하지만 알파값이 증가함에 따라 변수들의 스케일이 줄어드는 것을 관점으로 그래프를 그린것인데 릿지보다 라쏘가 0으로 빠르게(기울기가 가파르게) 향하는 것을 볼 수 있다.

※ 본 포스팅은 패스트캠퍼스 환급 챌린지 참여를 위해 작성었습니다.

※ 관련 링크 : https://bit.ly/37BpXiC

'스터디 > 패스트캠퍼스' 카테고리의 다른 글

| 패스트캠퍼스 챌린지 36일차 (0) | 2022.02.28 |

|---|---|

| 패스트캠퍼스 챌린지 35일차 (0) | 2022.02.27 |

| 패스트캠퍼스 챌린지 33일차 (0) | 2022.02.25 |

| 패스트캠퍼스 챌린지 32일차 (0) | 2022.02.24 |

| 패스트캠퍼스 챌린지 31일차 (0) | 2022.02.23 |